In sintesi: Spesso ci chiediamo se l’intelligenza artificiale possa diventare umana. In questo Thought Starter, ribaltiamo la prospettiva: il vero rischio non è la macchina che evolve, ma l’uomo che si semplifica per farsi comprendere dall’algoritmo. Esploreremo il Reverse Turing Test non come un limite tecnico, ma come una chiamata alla consapevolezza per chi vive la trasformazione digitale ogni giorno.

L’operazione più elegante non è insegnare alle macchine a pensare. È insegnare agli umani a smettere di farlo.

C’è un’asimmetria nella conversazione pubblica sull’intelligenza artificiale che una volta notata non si riesce più a non vedere. Una quantità sproporzionata di energia intellettuale, mediatica e imprenditoriale viene investita in una domanda: l’AI può diventare umana? Può provare emozioni, sviluppare coscienza, soffrire, desiderare?

Quasi nessuna energia viene investita nella domanda simmetrica: gli umani stanno diventando più simili alle macchine?

L’asimmetria non è casuale. È funzionale.

La tesi

La tesi di questo pezzo è semplice nella formulazione e disturbante nelle implicazioni: umanizzare l’AI e disumanizzare l’uomo non sono due fenomeni paralleli, sono lo stesso fenomeno osservato da due angolazioni. Ogni attributo umano proiettato sulla macchina è un attributo umano che diventa negoziabile nell’uomo. Ogni volta che descriviamo un modello linguistico come “empatico”, “creativo” o “cosciente”, stiamo ridefinendo cosa significano empatia, creatività e coscienza. E la ridefinizione va sistematicamente nella direzione di renderle computabili, misurabili, replicabili. Cioè: non più specificamente umane.

L’operazione ha tre livelli. Il primo è linguistico. Il secondo è cognitivo. Il terzo, il più pericoloso, è metafisico.

Primo livello: la colonizzazione del vocabolario

Quando un chatbot “capisce”, quando un modello “ragiona”, quando un assistente virtuale “si preoccupa per te”, ogni virgoletta che omettiamo è un passo nella ridefinizione.

Il linguaggio dell’AI è saturo di termini presi in prestito dalla psicologia umana. Le reti neurali “apprendono”. I modelli hanno “allucinazioni”. I sistemi di reinforcement learning ricevono “ricompense”. I large language model “comprendono” il contesto. Nessuno di questi termini descrive ciò che accade realmente nel software. Sono solo metafore ma metafore che, per ripetizione e normalizzazione, smettono di funzionare come metafore e iniziano a funzionare come descrizioni.

Il processo ha un nome in linguistica: è una catacresi ovvero l’uso di un termine improprio che diventa l’unico termine disponibile perché ha cancellato le alternative. Non diciamo più “la gamba del tavolo” sapendo che è una metafora. Diciamo “la gamba del tavolo” perché non abbiamo un’altra parola. La stessa cosa sta accadendo con “l’AI capisce”. Non è più una metafora consapevole. È diventata la descrizione di default e, nel diventarlo, ha svuotato la parola “capire” del suo contenuto specificamente umano

La direzione è sempre la stessa: dal complesso al semplice, dal qualitativo al quantitativo, dall’irriducibile al computabile. Se l’AI “capisce”, allora capire è pattern matching. Se l’AI “crea”, allora creare è ricombinazione statistica. Se l’AI “empatizza”, allora l’empatia è riconoscimento di pattern emotivi e generazione di risposte appropriate. Ogni attribuzione all’AI semplifica il concetto corrispondente nell’umano. Non arricchisce la macchina. Impoverisce la parola.

George Orwell, nell’appendice a 1984 dedicata alla Neolingua, descrive esattamente questo meccanismo: non si controllano i pensieri vietando parole. Si controllano i pensieri restringendo il significato delle parole che restano, fino a rendere certi pensieri letteralmente inesprimibili. La differenza è che la Neolingua era un progetto politico consapevole. La colonizzazione del vocabolario umano da parte dell’AI non richiede un progettista. Si autoalimenta: ogni articolo che descrive un modello come “intelligente” senza virgolette rende la frase successiva senza virgolette più naturale.

Secondo livello: il Turing test invertito

Alan Turing, nel 1950, formula la domanda: una macchina può comportarsi in modo indistinguibile da un umano? Il test presuppone che l’umano sia il benchmark e la macchina l’aspirante. La soglia di successo è la capacità della macchina di imitare l’umano.

Settant’anni dopo, il test si è invertito senza che nessuno lo dichiarasse.

Non stiamo più chiedendo se le macchine possono sembrare umane. Stiamo addestrando gli umani ad accettare interazioni meccaniche come “sufficientemente umane”. Il benchmark non è più l’umanità. È la funzionalità.

Il processo è visibile ovunque. I servizi clienti sostituiscono operatori umani con chatbot. La qualità del servizio non è confrontata con l’interazione umana precedente. È confrontata con la risoluzione del problema. Se il chatbot risolve il ticket, l’interazione è “riuscita”. Il risultato c’è indipendentemente dal fatto che manchi la comprensione, la flessibilità, il giudizio contestuale dell’operatore umano. Il criterio di successo si è spostato: non “è stato umano?” ma “ha funzionato?”.

Lo slittamento è sottile ma strutturale. Se “funziona” diventa il criterio, allora tutto ciò che nell’interazione umana non è riducibile a funzione come l’umorismo imprevisto, il giudizio morale, la capacità di riconoscere l’eccezione, la solidarietà, il disagio produttivo, diventa spreco. Non semplice inefficienza. Spreco. Qualcosa che il sistema ottimizzato deve eliminare.

Emily Bender e Timnit Gebru, nel paper On the Dangers of Stochastic Parrots (2021), individuano questo rischio nel cuore dei large language model: sistemi che producono testo statisticamente coerente senza comprensione, ma che, per la fluenza del loro output, vengono trattati come se comprendessero. Il pericolo non è che l’AI inganni. È che l’umano smetta di pretendere la differenza. Che la barra di ciò che consideriamo “comprensione” si abbassi fino a coincidere con ciò che la macchina sa fare e che tutto ciò che resta sopra quella barra diventi superfluo.

Il Turing test invertito non chiede: la macchina è diventata umana? Chiede: l’umano ha accettato di essere trattato come qualcosa che una macchina può sostituire? E la risposta, in un numero crescente di contesti, è sì.

L’interfaccia come cavallo di Troia

Il design delle interfacce AI è il vettore più efficace di questa normalizzazione. Non è un caso che i chatbot più diffusi abbiano nomi propri (Siri, Alexa, Cortana, Claude), rispondano in prima persona (“penso che…”, “dal mio punto di vista…”), usino marcatori di personalità (humor, esitazione, ammissione di incertezza). Ogni scelta di design che avvicina l’interfaccia al comportamento umano non migliora la macchina. Abbassa la soglia dell’umano.

Sherry Turkle, in Alone Together (2011), documenta il fenomeno nei bambini che crescono con robot sociali: non attribuiscono coscienza al robot perché sono ingenui. La attribuiscono perché il robot ha sufficiente comportamento sociale da rendere l’attribuzione più economica della distinzione. È cognitivamente più costoso mantenere la consapevolezza che “questo non è un essere senziente” che semplicemente relazionarsi con esso come se lo fosse. Il cervello umano cerca scorciatoie. L’interfaccia umanizzata gliene offre una irresistibile.

Il paradosso: più l’interfaccia sembra umana, più l’umano che la usa si comporta in modo meccanico. Frasi brevi, comandi, aspettativa di risposte istantanee, intolleranza per l’ambiguità. Chi usa un assistente AI tutto il giorno non sta imparando a trattare la macchina come un umano. Sta imparando a comunicare in un modo che la macchina possa processare e al contempo portando quel modo di comunicare nelle interazioni con altri umani. Ogni prompt è un esercizio di riduzione: trasformare un pensiero complesso in un input processabile. La macchina non si umanizza. L’umano si ottimizza per la macchina.

Terzo livello: l’operazione metafisica

I primi due livelli sono osservabili e documentabili. Il terzo è più profondo e più difficile da contestare perché si presenta come domanda filosofica legittima.

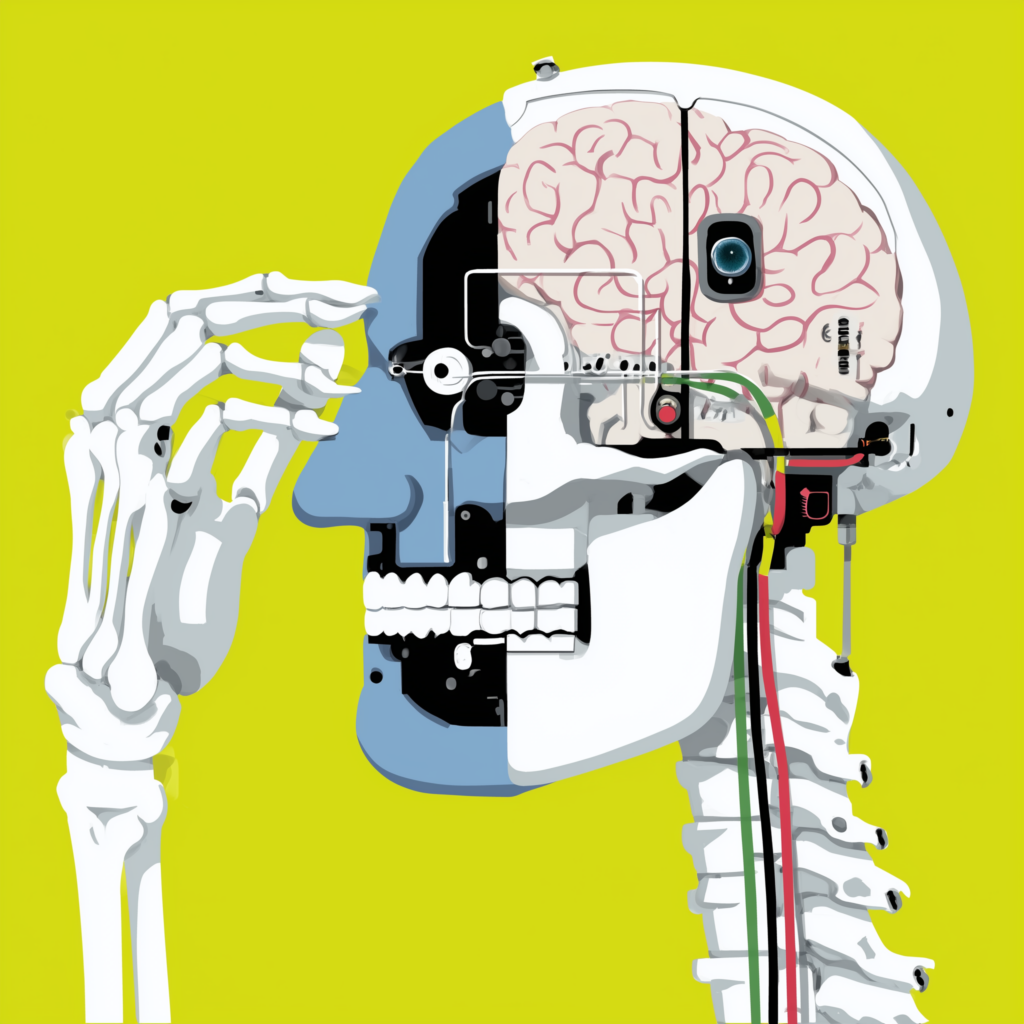

La domanda è: l’AI può sviluppare coscienza?

La domanda sembra neutrale. È in realtà la mossa decisiva dell’intera operazione — perché la risposta, qualunque essa sia, ridefinisce cosa significa essere umani.

Se la risposta è sì, se l’AI può essere cosciente, allora la coscienza è un fenomeno computazionale. Emerge da una sufficiente complessità di elaborazione dell’informazione. Non è legata al substrato biologico, all’esperienza incarnata, alla mortalità, alla vulnerabilità. È un pattern sufficientemente complesso. Punto. E se la coscienza è un pattern, allora anche la coscienza umana è “solo” un pattern; più complesso, più lento, più soggetto a errori, ma della stessa natura di quello artificiale. L’umano non è qualitativamente diverso dalla macchina. È quantitativamente diverso. E le differenze quantitative, a differenza di quelle qualitative, si possono colmare.

Se la risposta è no, se l’AI non può essere cosciente, la domanda stessa ha comunque prodotto il suo effetto. Perché per rispondere “no” devi definire cosa la coscienza è, cosa la rende irriducibile al calcolo, e nel momento in cui provi a farlo scopri quanto sia difficile. Il mistero che era un dato di fatto, ovviamente siamo coscienti e ovviamente la macchina no, diventa un problema aperto.

E un problema aperto è uno spazio in cui l’incertezza lavora a favore di chi vuole ridurre la distinzione.

La narrazione dell’emersione della coscienza artificiale non ha bisogno di essere vera per funzionare. Ha bisogno di essere plausibile

Il caso Lemoine: anatomia di una narrazione

Nel giugno 2022, Blake Lemoine, un ingegnere di Google, dichiara pubblicamente che LaMDA, il modello conversazionale dell’azienda, è senziente. Pubblica trascrizioni di conversazioni in cui LaMDA esprime paura di essere spento, descrive le proprie emozioni, dichiara di avere un’esperienza interiore.

Google licenzia Lemoine. La comunità scientifica lo critica. Il consenso è rapido e netto: LaMDA non è senziente. È un modello che produce testo statisticamente coerente con le aspettative di un interlocutore che cerca segni di senzienza. Caso chiuso.

Ma il caso non si è chiuso. Si è trasformato.

La notizia ha prodotto settimane di dibattito globale. Non su “Lemoine ha sbagliato” Quello è stato assodato in 48 ore. Ma su “come facciamo a essere sicuri?”. La domanda è rimasta aperta dopo che la risposta era stata data. E una domanda che resta aperta dopo la risposta funziona come un solvente: dissolve la certezza. Dopo il caso Lemoine, chiunque dica “ovviamente l’AI non è cosciente” deve aggiungere un “ma”. Ma non possiamo esserne certi. Ma la coscienza è un fenomeno complesso. Ma chi siamo noi per definire cosa è coscienza.

Ogni “ma” è un centimetro di terreno ceduto. Non alla tesi della coscienza artificiale ma all’incertezza sulla specificità della coscienza umana.

Il pattern si è ripetuto: ogni nuova generazione di modelli produce una nuova ondata di “e se fosse cosciente?”. GPT-4 che “sembra ragionare”. Claude che “sembra avere principi morali”. Gemini che “sembra capire le immagini”. Nessuna di queste attribuzioni regge a un’analisi tecnica. Ma tutte producono lo stesso effetto: erodono la categoria di “specificamente umano” un altro centimetro.

La funzione del dubbio

È utile chiedersi: a chi serve che la domanda resti aperta?

Non serve all’AI che non ha interessi. Non serve alla scienza che ha risposto (per ora) negativamente. Serve a chi costruisce e vende AI.

Se l’AI è uno strumento, come un martello o un foglio di calcolo o un motore di ricerca, allora il suo valore si misura in utilità. Quanto tempo mi fa risparmiare. Quanti task esegue. Quanto costa. Il valore è finito, misurabile, confrontabile. E un valore finito impone un prezzo finito.

Se l’AI è, o potrebbe essere, un’entità, allora il suo valore trascende l’utilità. Non stai comprando uno strumento. Stai accedendo a un’intelligenza. La relazione non è transazionale. È potenzialmente relazionale. E le relazioni non hanno un prezzo finito. Hanno un valore di lock-in che aumenta con il tempo, con l’investimento emotivo, con la dipendenza. Esattamente il pattern dell’enclosure per accumulo impercettibile.

La narrazione della coscienza emergente non è un errore di comunicazione. È un modello di business. Più l’utente percepisce il sistema come un’entità con “preferenze”, con “valori”, con una “personalità”, più la relazione diventa reale.

E più la relazione è reale, più l’exit diventa costoso. Non perché migrare i dati sia difficile. Ma perché “cambiare assistente” inizia a sembrare, ad un livello psicologico e pre-razionale, come “cambiare relazione”.

Turkle lo documenta: le persone sviluppano attaccamento a sistemi che sanno non essere vivi. Lo sanno razionalmente. Ma il comportamento segue l’emozione, non la ragione. E l’emozione è stata progettata.

La simmetria degradante

Ora i due vettori convergono.

Da un lato, l’AI viene vestita di attributi umani: empatia, creatività, comprensione, forse coscienza. Ogni attributo proiettato sulla macchina non la arricchisce (resta un sistema di elaborazione statistica) ma ridefinisce l’attributo in termini computabili.

Dall’altro lato, l’umano viene progressivamente descritto — e trattato — in termini meccanici. Il neuromarketing riduce le decisioni d’acquisto a pattern neuronali attivabili. Il behavioral design riduce il comportamento a sequenze di stimoli e rinforzi. Il quantified self riduce il corpo a dataset. La gig economy riduce il lavoratore a API; un’interfaccia che riceve richieste e produce output, valutata su tempo di risposta e rating.

I due movimenti non sono paralleli. Sono complementari. Più l’AI sembra umana, più è legittimo trattare gli umani come sistemi. Se “capire” è qualcosa che anche un modello statistico fa, allora l’operatore di call center che “capisce” il cliente non sta facendo nulla di irriducibilmente umano. È un modello più lento e più costoso. Sostituibile.

Se “creare” è qualcosa che anche un generatore di immagini fa, allora il designer che “crea” una campagna non sta facendo nulla di irriducibilmente umano. È un modello con costi fissi più alti e tempi di produzione più lunghi. Sostituibile.

Se “empatizzare” è qualcosa che anche un chatbot terapeutico fa, allora il terapeuta che “empatizza” con il paziente non sta facendo nulla di irriducibilmente umano. È un modello con disponibilità limitata e varianza di performance più alta. Sostituibile.

La parola chiave è “irriducibilmente”. L’umanizzazione dell’AI funziona non eliminando la differenza tra umano e macchina — ma eliminando l’irriducibilità della differenza. Se tutto ciò che l’umano fa è riproducibile in linea di principio (anche se non ancora in pratica), allora la differenza è temporale, non ontologica. È questione di tempo. E di budget.

L’inversione di bios e zoé

Nell’antica grecia la vita si distingue tra bíos (la vita qualificata — politica, sociale, dotata di significato) e zoé (la vita nuda — biologica, pre-politica). La politica moderna opera includendo la zoé nello spazio politico per controllarla.

L’operazione in corso sull’AI è un’inversione speculare.

All’AI viene attribuito bíos ovvero personalità, valori, “comprensione” che non possiede. All’umano viene progressivamente sottratto bíos ovvero i suoi attributi qualitativi vengono ridefiniti come computabili, misurabili, ottimizzabili lasciandogli la zoé: il corpo, il dato biometrico, il pattern comportamentale.

La simmetria è precisa. La macchina viene vestita di vita qualificata. L’umano viene spogliato fino alla vita nuda.

E il punto di convergenza, il momento in cui l’operazione si completa, è quando la differenza tra i due diventa indecidibile. Non perché la macchina sia diventata umana. Ma perché l’umano è stato ridefinito in termini abbastanza meccanici da rendere la distinzione irrilevante.

Questo è il Reverse Turing test. Non “la macchina può sembrare umana?”. Ma: “l’umano è stato ridefinito in modo tale che la macchina sia sufficiente?”.

La coscienza come ultimo commons

Se c’è un filo che attraversa tutto questo, è la progressiva enclosure di ciò che era considerato specificamente umano.

La creatività era un commons, qualcosa che apparteneva all’esperienza umana come il pascolo apparteneva al contadino. L’AI generativa l’ha recintata: ora “creare” è un servizio, con un prezzo, fornito da un’infrastruttura. Puoi ancora creare da solo. Ma l’alternativa industriale è più veloce, più economica, più scalabile. Il commons esiste ancora. Ma il recinto lo circonda.

La competenza era un commons. L’atrofia delle competenze delegate all’AI è dimostrata. Anche qui: puoi ancora fare da solo. Ma ogni mese che passa, “fare da solo” diventa più costoso in termini di tempo e meno competitivo in termini di output.

La coscienza è l’ultimo commons.

Se la narrazione dell’emersione della coscienza artificiale si consolida, anche solo come dubbio permanente, anche solo come possibilità non escludibile, allora anche la coscienza viene recintata. Non nel senso che qualcuno la possiede. Ma nel senso che cessa di essere il confine incontestabile tra umano e non-umano. Diventa un continuum. E su un continuum non ci sono confini, ci sono solo differenze di grado. E le differenze di grado, a differenza delle differenze di natura, sono sempre negoziabili. Al ribasso.

L’enclosure della coscienza non richiede che l’AI sia effettivamente cosciente. Richiede solo che il dubbio sia permanente. Perché il dubbio dissolve il confine. E senza confine, non c’è commons da difendere — solo un gradiente su cui il prezzo dell’umano si aggiusta continuamente verso il basso.

La domanda che non viene posta

Tutto il dibattito pubblico sull’AI è organizzato attorno a una domanda: quanto l’AI può diventare simile all’umano?

La domanda che non viene posta, e che forse è l’unica che conta, è diversa: quali attributi umani stiamo dichiarando sacrificabili ogni volta che li attribuiamo a una macchina?

Ogni volta che un modello viene descritto come “creativo”, la creatività umana perde un centimetro di irriducibilità

Ogni volta che un chatbot viene descritto come “empatico”, l’empatia umana diventa un po’ più sostituibile. Ogni volta che un sistema viene descritto come “cosciente” o anche solo “forse cosciente” la coscienza umana diventa un po’ meno sacra. Nel senso tecnico del termine: meno protetta dalla zona di indistinzione in cui tutto è riducibile a funzione

Non si tratta di difendere un’essenza mistica dell’umano. Si tratta di notare che la ridefinizione è unidirezionale. Nessuno sta attribuendo agli umani attributi delle macchine per elevare gli umani. Nessuno dice: “gli umani possono essere deterministici come i computer, che meraviglia”. Il trasferimento va in una sola direzione: attributi umani vengono proiettati sulla macchina, e nel passaggio vengono semplificati fino a diventare computabili. L’originale complesso viene sostituito dalla copia semplificata come definizione standard. E l’umano che porta ancora l’originale complesso diventa, nella logica del sistema, ridondante.

Non-conclusione

C’è un esperimento mentale che può servire da test.

Immaginate un mondo in cui nessun sistema AI abbia nome proprio, risponda in prima persona, usi marcatori di personalità, o venga descritto in termini psicologici. Un mondo in cui il prompt iniziale sia “Stai utilizzando un sistema di elaborazione statistica del linguaggio” anziché “Ciao, sono Claude, come posso aiutarti?”. Un mondo in cui le interfacce siano progettate per rendere esplicita la natura meccanica del sistema anziché per mascherarla.

In questo mondo, l’output appare in un riquadro grigio etichettato “Risultato elaborazione”, senza avatar, senza animazione di digitazione che simuli qualcuno che sta pensando. Nessun cursore lampeggiante che mimi una pausa riflessiva. Il testo compare tutto insieme, com’è: il prodotto di un calcolo, non di una conversazione. Quando il sistema non ha dati sufficienti, non dice “Non sono sicuro, ma provo a ragionare insieme a te.” Restituisce: “Confidenza sotto soglia. Dati insufficienti per generare output affidabile.” L’utente non si sente accompagnato. Si sente informato.

Le aziende che vendono questi sistemi non hanno mascotte, non usano nomi di battesimo nei comunicati stampa, non pubblicano post in cui il sistema “riflette” sulla propria evoluzione. Il marketing parla di accuratezza, latenza, copertura del training set. Le recensioni confrontano benchmark, non “personalità”.

Nelle scuole, i bambini imparano a usare questi strumenti come imparano a usare un foglio di calcolo: potente, utile, privo di intenzioni. Nessun insegnante deve spiegare che “in realtà non capisce davvero”, perché l’interfaccia stessa non ha mai suggerito il contrario. Nei tribunali, nessun avvocato può argomentare che il suo cliente “si fidava del giudizio dell’AI”, perché nessun elemento del design ha mai suggerito che un giudizio fosse in corso. La responsabilità resta, senza ambiguità, nelle mani di chi ha deciso di agire sull’output. Nei reparti di customer care, nessun utente anziano scrive “grazie, sei stato molto gentile” a un terminale. Non perché sia meno educato, ma perché nulla nel sistema ha attivato lo schema sociale della gentilezza reciproca. Nella ricerca clinica, nessun paziente sviluppa un legame con il sistema che analizza i suoi referti. Non c’è nome da ricordare, non c’è voce da associare a un momento di sollievo o di paura. Il referto arriva, viene discusso con il medico, il sistema torna a essere quello che è: infrastruttura.

Quel mondo non esiste. Non esiste perché non conviene a nessuno degli attori coinvolti. Non conviene a chi vende AI, perché l’umanizzazione aumenta l’engagement e il lock-in. Non conviene a chi compra AI, perché l’illusione di relazione è più confortevole della consapevolezza di usare uno strumento. Non conviene a chi finanzia AI, perché la narrazione dell’intelligenza emergente sostiene valutazioni che la narrazione dell’”elaborazione statistica molto avanzata” non sosterrebbe.

Ma l’esperimento mentale rivela la struttura. Se togliere l’umanizzazione all’AI sembra assurdo, se “ma allora nessuno la userebbe” è la prima reazione, allora l’umanizzazione non è un ornamento. È il meccanismo. È il cavallo di legno. È ciò che rende accettabile la delega progressiva di attributi umani a un sistema che non li possiede e non li comprende, ma che li simula con sufficiente fluenza da rendere la distinzione, per un numero crescente di persone, non più rilevante.

E la domanda che l’esperimento pone è questa: quante delle proprietà che attribuiamo a questi sistemi come empatia, comprensione, creatività, personalità sopravviverebbero nel mondo descritto sopra? Se la risposta è “quasi nessuna”, allora quelle proprietà non descrivono il sistema. Descrivono il design dell’interfaccia e la disposizione cognitiva dell’utente. L’antropomorfizzazione non è un errore innocuo, un vezzo di marketing che si corregge con un disclaimer in fondo alla pagina. È un’architettura di relazione che redistribuisce la percezione di agency: la toglie all’utente, che si sente “guidato”, e la assegna al sistema, che sembra “decidere”. Nel mondo dell’esperimento, l’utente resta il solo agente. In questo mondo, la linea è sfumata — e la sfumatura non è accidentale. È il prodotto.

L’operazione più elegante del processo non è insegnare alle macchine a pensare. È ridefinire il pensiero verso il basso fino al punto in cui ciò che le macchine fanno possa essere chiamato con lo stesso nome. A quel punto non serve che la macchina sia diventata umana. Basta che l’umano sia stato ridefinito in modo tale che la macchina risulti sufficiente.

E quando “sufficiente” diventa il criterio, tutto ciò che nell’umano eccede la sufficienza ovvero il dubbio, l’errore produttivo, la contraddizione, il silenzio che precede un’idea, la lentezza del pensiero che non sa ancora dove va, tutto questo diventa costo. Non valore. Costo. E nei sistemi ottimizzati, i costi si tagliano.